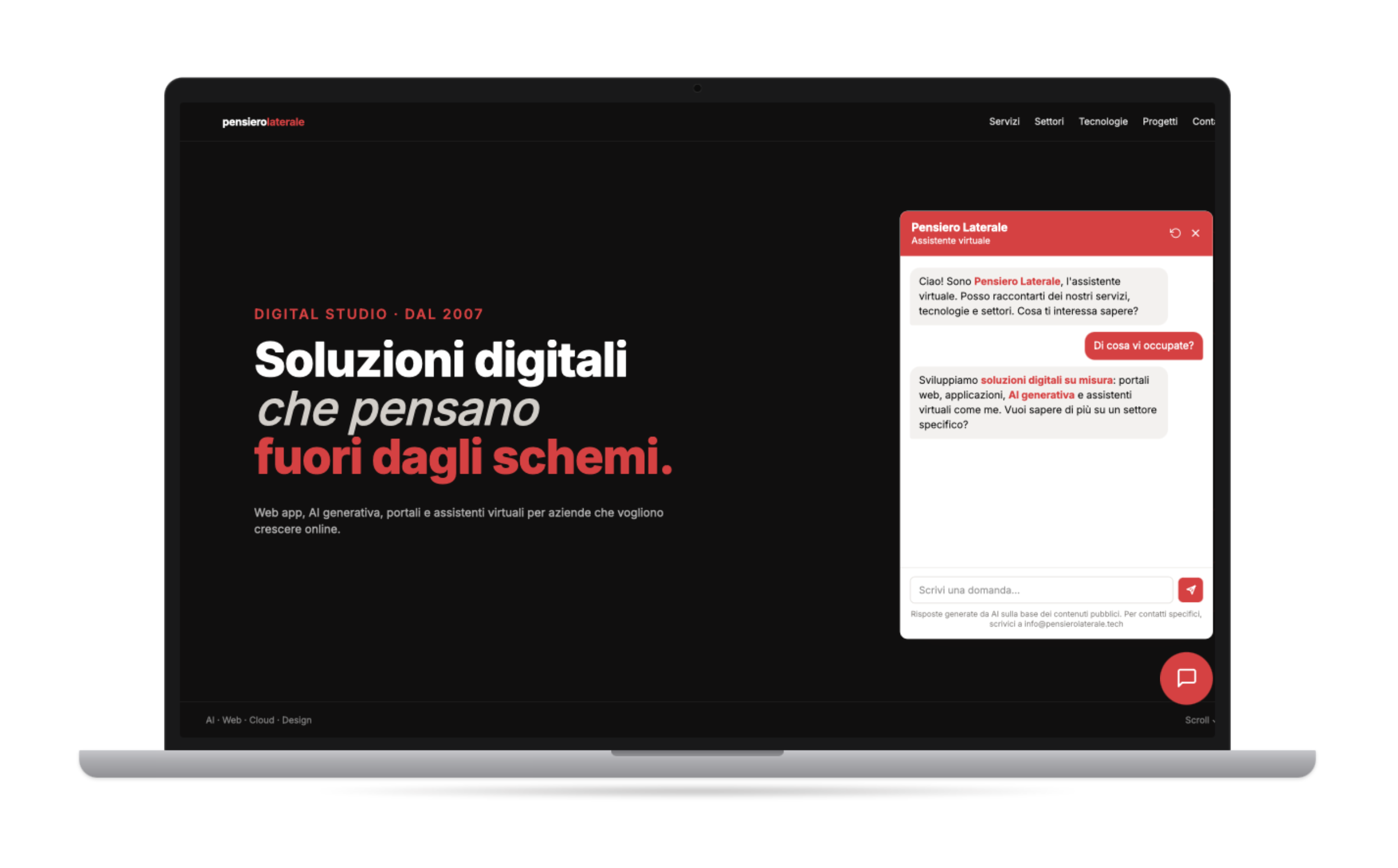

Un assistente conversazionale che parla davvero del mio lavoro

Quando un visitatore arriva sul sito, spesso non ha tempo di leggere tutto. Vuole una risposta diretta: “Mi puoi aiutare con questo problema specifico?”, “Hai esperienza nel mio settore?”, “Quanto costa?”. Per rispondere a queste domande in modo immediato e contestuale ho costruito un chatbot che attinge alla mia knowledge base personale e risponde come risponderei io.

Cosa fa

L’assistente conosce nel dettaglio chi sono, cosa offro, in quali contesti ho lavorato, come imposto un ingaggio e soprattutto cosa non faccio. Quando una domanda esce dal mio perimetro lo dichiara apertamente, invece di inventare risposte plausibili ma false. È una scelta di posizionamento: meglio un “no, questo non è il mio mestiere” che un cliente disilluso al primo meeting.

Non è un wrapper di ChatGPT

Differenza cruciale rispetto alle decine di “chatbot AI” che si vedono in giro: questo non passa la domanda dell’utente a un modello generico sperando in una risposta ragionevole. Funziona così:

- La mia esperienza professionale è strutturata in una base di conoscenza editoriale (servizi, competenze, casi, FAQ, modalità di lavoro)

- Per ogni domanda dell’utente, il sistema individua i frammenti di contenuto più rilevanti

- Solo a quel punto un modello linguistico genera la risposta, vincolato a usare esclusivamente quei frammenti come fonte

Il risultato è un assistente che parla di me con le mie parole, aggiornabile semplicemente modificando la knowledge base, senza riaddestrare nulla.

Riutilizzabile per altri contesti

L’architettura è agnostica rispetto al contenuto. Lo stesso scheletro tecnico può diventare:

- Pre-sales per uno studio professionale – risponde a domande su servizi, tariffe, modalità di ingaggio, riferimenti normativi

- Assistente alla documentazione tecnica – guida sviluppatori e utenti dentro manuali corposi, citando le sezioni rilevanti

- Supporto clienti di primo livello – gestisce le FAQ ricorrenti su prodotto, ordini, garanzie, lasciando agli operatori solo i casi davvero complessi

- Onboarding interno HR – risponde ai nuovi assunti su policy aziendali, benefit, procedure

- Consulente normativo verticale – interroga corpus regolamentari (privacy, sicurezza, settore-specifico) restituendo riferimenti puntuali

In ogni caso la formula è la stessa: fornisci il contenuto autorevole, definisci il tono e il perimetro, scegli dove far vivere il widget. Il sistema impara la “voce” dal materiale che gli dai, non da un addestramento esterno.

Costi sostenibili e dati sotto controllo

A differenza delle soluzioni SaaS chatbot in abbonamento, questo progetto ha costi operativi marginali: poche decine di euro al mese anche per traffico medio-alto, perché paga solo l’effettivo consumo del modello. Il database vettoriale e il codice vivono su infrastruttura del cliente — nessun dato di conversazione transita su piattaforme di terze parti oltre il provider del modello, scelto in base ai requisiti di privacy del progetto (Gemini, OpenAI, Anthropic, oppure modelli on-premise per scenari sensibili).

Cosa porta a un progetto

Non sto vendendo un prodotto chiavi in mano: sto offrendo una pipeline rodata e una metodologia. Ogni implementazione richiede una fase iniziale di analisi del contenuto disponibile, definizione del tono di voce, scrittura del prompt di sistema, calibrazione del retrieval. È lavoro sartoriale su uno scheletro solido, non un copia-incolla di template.

Informazioni

Category:

Mobile Appplication, Web Application, Web Site

Data:

Maggio 2, 2026

Tags:

AI, LLM, RAG